200달러.

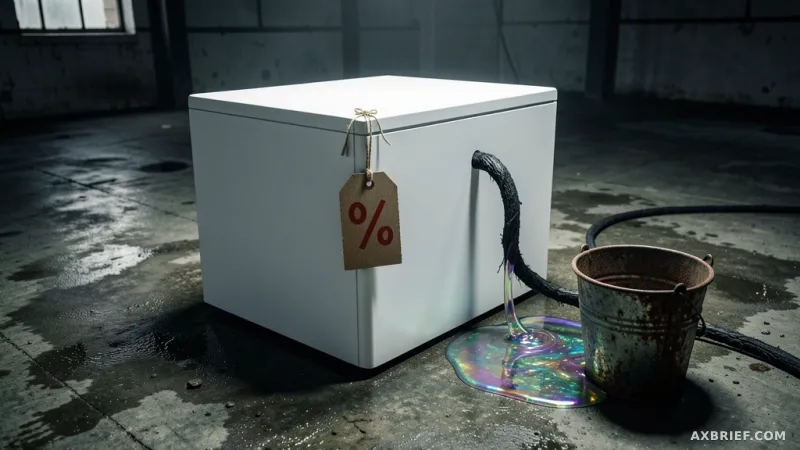

Anthropic(인공지능 모델 개발사)의 Max 요금제 월 구독료다. 한 명의 사용자가 내야 할 비용을 수십 명이 쪼개 쓰는 셈이다. 그런데 이번 주 깃허브(코드 저장소 및 협업 플랫폼)와 텔레그램(메신저 앱)의 암시장 채널에서는 공식 가격의 10%만 내면 Claude API(응용 프로그램 인터페이스, 소프트웨어 간 통신 규칙)를 제공한다는 제안이 쏟아지고 있다.

API 프록시 경제의 작동 방식

옥스포드 중국 정책 연구소의 질란 첸 연구원은 이를 API 프록시 경제라고 명명했다. 이들은 GitHub(코드 저장소 및 협업 플랫폼), Telegram(메신저 앱), 타오바오(중국 전자상거래 플랫폼) 등에서 공개적으로 활동하며 저렴한 접근권을 판매한다. 가격을 낮추는 수법은 세 가지로 나뉜다. 무료 체험 계정을 대량 생성해 권한을 재판매하거나, 도난 신용카드로 유료 플랜에 가입해 접근권을 분배한다. 혹은 월 200달러의 Max 요금제 하나를 여러 사용자에게 쪼개어 판매하는 방식이다.

일부 프록시 운영자는 모델 바꿔치기라는 기만 전술을 쓴다. 사용자는 최고 성능 모델인 Claude Opus를 사용하고 있다고 믿지만, 실제로는 훨씬 저렴한 Claude Haiku(경량화 모델)나 오픈소스 모델로 응답을 돌려보낸다. 사용자는 비용을 아꼈다고 생각하지만, 실제로는 성능이 낮은 모델의 결과물을 받으면서 비용만 지불하는 구조다.

공식 API 대비 성능 하락과 데이터 유출

공식 API와 프록시 서비스의 성능 격차는 수치로 명확히 갈린다. 독일 CISPA 헬름홀츠 정보보안센터(정보 보안 연구 기관)가 17곳의 프록시 서비스를 분석한 결과, 의료 분야 벤치마크(성능 측정 기준점)에서 공식 API는 84%의 정답률을 보였다. 반면 프록시 서비스의 정답률은 37% 수준에 그쳤다. 주목할 점은 비용 절감이 결과물의 품질 하락으로 직결되었다는 사실이다.

단순한 성능 저하보다 위험한 것은 데이터의 흐름이다. 공식 서비스는 보안 가이드라인을 따르지만, 프록시 서버는 사용자가 입력한 프롬프트와 AI의 답변, 그리고 CoT(사고 사슬, AI가 정답에 도달하는 추론 과정)를 모두 저장한다. 프록시 운영자가 노리는 진짜 수익원은 API 재판매 대금이 아니라 사용자의 데이터다. 이렇게 수집된 고품질의 추론 데이터는 다른 AI 모델을 학습시키기 위한 자산으로 가공되어 암시장에서 판매된다.

학습 데이터 탈취와 보안 위협의 결과

개발자가 체감하는 가장 치명적인 결과는 내부 자산의 유출이다. AI 코딩 에이전트(코드를 자동으로 작성해 주는 도구)를 사용하는 개발자는 소스코드뿐만 아니라 API 구조와 내부 인증 정보까지 입력하는 경우가 많다. 검증되지 않은 프록시 서버를 거치는 순간, 기업의 핵심 기밀이 제3자의 서버로 그대로 전송된다. 질란 첸 연구원은 검증되지 않은 프록시를 사용하는 것이 기밀 데이터를 제3자 서버로 보내는 것과 다름없다고 경고했다.

탈취된 데이터는 실제로 경쟁 모델의 성능 개선에 활용되고 있다. 최근 중국 AI 모델들의 추론 능력이 급격히 상승한 배경에는 이러한 데이터 확보 구조가 기여했다는 분석이 나온다. Anthropic은 올해 2월, DeepSeek(중국 AI 기업), Moonshot AI(중국 AI 기업), MiniMax(중국 AI 기업) 등과 연관된 사기 계정 2만 4,000개에서 1,600만 건 이상의 쿼리가 발생했음을 밝혔다. 이는 단순한 계정 도용을 넘어 조직적인 데이터 수집이 이루어졌음을 시사한다.

저렴한 API 게이트웨이는 서비스 제공이 아니라 고품질 학습 데이터를 수집하기 위한 정교한 미끼 상품이다.