인디 해커 L씨는 수만 줄의 코드 파일과 수백 페이지의 기술 문서를 한 번에 AI에게 입력하려다 메모리 부족 오류를 마주했다. 입력값이 길어질수록 메모리 점유율이 치솟고 답변 속도가 느려지는 현상은 그동안의 거대 언어 모델들이 가진 고질적인 한계였다. 이런 곤란을 겪는 개발자가 늘고 있다.

DeepSeek-V4의 MoE 구조와 학습 데이터

DeepSeek-V4 시리즈는 MoE(전체 파라미터 중 일부만 활성화해 연산 효율을 높이는 구조) 방식을 채택했다. DeepSeek-V4-Pro는 전체 1.6조 개의 파라미터 중 추론 시 490억 개만 사용하며, DeepSeek-V4-Flash는 전체 2840억 개 중 130억 개를 활성화해 가벼운 구동 환경을 제공한다. 두 모델 모두 최대 100만 토큰의 문맥 길이를 지원하며, FP8(8비트 부동 소수점) 혼합 정밀도나 MoE 전문가 파라미터에 FP4(4비트 부동 소수점)를 적용한 방식을 사용한다.

학습 과정에서는 32조 개 이상의 고품질 토큰을 사전 학습한 뒤 정교한 사후 학습 파이프라인을 거쳤다. SFT(지도 미세 조정)와 GRPO(그룹 상대 정책 최적화 기반 강화 학습)를 통해 도메인별 전문가를 먼저 육성하고, 온폴리시 증류(모델의 출력을 다시 학습 데이터로 사용하는 기법)로 이를 하나의 통합 모델로 응집시키는 2단계 패러다임을 적용했다. 여기에 Muon(빠른 수렴을 돕는 최적화 알고리즘) 옵티마이저와 mHC(매니폴드 제약 하이퍼 연결 구조)를 도입해 학습 안정성을 높였다.

하이브리드 어텐션 도입과 자원 효율성

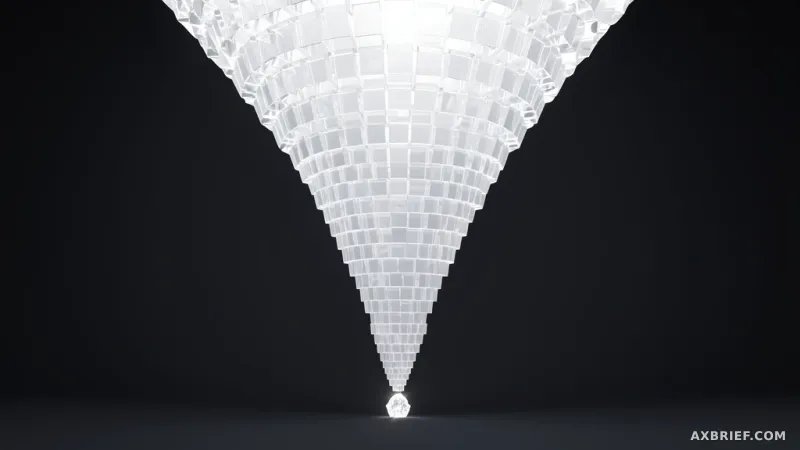

이번 모델의 핵심은 하이브리드 어텐션(입력 데이터의 중요도를 계산하는 방식) 아키텍처의 도입이다. CSA(압축 희소 어텐션)와 HCA(고압축 어텐션)를 결합해 장문 처리 효율을 극대화했다. 비유하자면, 예전에는 공부할 때 책 전체를 옆에 펼쳐놓고 계속 들춰봤다면, 이제는 핵심 내용만 적은 포스트잇 몇 장으로 전체 내용을 파악하는 식이다.

이전 버전인 DeepSeek-V3.2와 비교하면 자원 사용량이 획기적으로 줄었다. 100만 토큰 문맥 설정에서 단일 토큰 추론 시 FLOPs(부동 소수점 연산량)를 27% 수준으로 낮췄다. 특히 문맥 기억을 위한 메모리 공간인 KV 캐시(Key-Value Cache, 이전 대화 내용을 저장하는 임시 저장소) 사용량을 10%까지 줄여 동일한 하드웨어에서 더 많은 데이터를 빠르게 처리할 수 있게 됐다.

실제 성능 지표에서도 성장이 확인된다. MMLU(일반 상식 및 지식 측정 벤치마크)에서 Pro-Base 모델은 90.1%의 정확도를 기록해 V3.2-Base의 87.8%를 넘어섰다. MMLU-Pro(더 까다로운 문제 세트)에서는 Pro-Base가 73.5%를 기록하며 V3.2-Base의 65.5% 대비 압도적인 성능 향상을 보였다. Pro-Max 모드는 코딩 벤치마크에서 최상위권 성적을 거두며 폐쇄형 모델과의 격차를 줄였고, Flash-Max 모델 역시 충분한 사고 예산을 할당받으면 Pro 버전과 유사한 추론 성능을 낸다.

모델을 직접 활용하려는 개발자는 Hugging Face에서 제공하는 CLI를 통해 다음과 같이 모델을 내려받을 수 있다.

huggingface-cli download deepseek-ai/DeepSeek-V4-Pro

huggingface-cli download deepseek-ai/DeepSeek-V4-Flash이제 모델의 크기가 아니라, 얼마나 효율적으로 기억하고 덜 사용하는가가 AI 경쟁의 핵심이 됐다.