지금 개발자 커뮤니티에서는 조금 이상한 이야기가 오가고 있다. 보통 AI 회사는 더 똑똑하고 강력한 모델을 내놓으려고 경쟁한다. 그런데 이번에는 오히려 기능을 조금 낮추고 안전 장치를 더 많이 넣은 모델이 나왔다. 사람들은 왜 굳이 성능을 낮춘 모델을 지금 이 시점에 내놓았는지 궁금해하고 있다.

Opus 4.7 출시와 보안 필터 적용

Anthropic이 새로운 AI 모델인 Opus 4.7을 세상에 내놓았다. 이 모델은 Amazon Bedrock(인터넷 저장소에서 AI를 빌려 쓰는 서비스)과 Google Cloud의 Vertex AI(구글이 만든 AI 개발 도구), 그리고 Microsoft Foundry(마이크로소프트의 AI 개발 공간)에서 바로 사용할 수 있다. 개발자들은 API(프로그램끼리 대화하는 통로)를 통해 자신의 서비스에 이 모델을 연결할 수 있다.

가격은 이전 버전인 Opus 4.6과 똑같다. AI가 읽고 쓰는 글자 조각인 토큰 100만 개당 입력은 5달러, 출력은 25달러다. 이번 모델의 핵심은 Project Glasswing(사이버 보안의 위험과 이점을 연구하는 프로젝트)의 결과물을 적용했다는 점이다. 나쁜 의도로 해킹 방법을 묻는 요청을 AI가 스스로 찾아내어 막아버리는 보안 기능이 탑재되었다.

성능보다 안전을 선택한 이유

개발자들 사이에서는 이번 출시를 두고 뜨거운 논쟁이 벌어지고 있다. 일부는 더 강력한 기능을 원했지만, 다른 쪽에서는 안전이 최우선이라는 반응이다. Anthropic은 더 강력한 모델인 미토스(Mythos)를 만들기 전에, Opus 4.7을 일종의 연습장으로 쓰고 있다. 너무 똑똑한 AI가 나쁜 사람의 손에 들어가면 위험한 무기가 될 수 있기 때문이다.

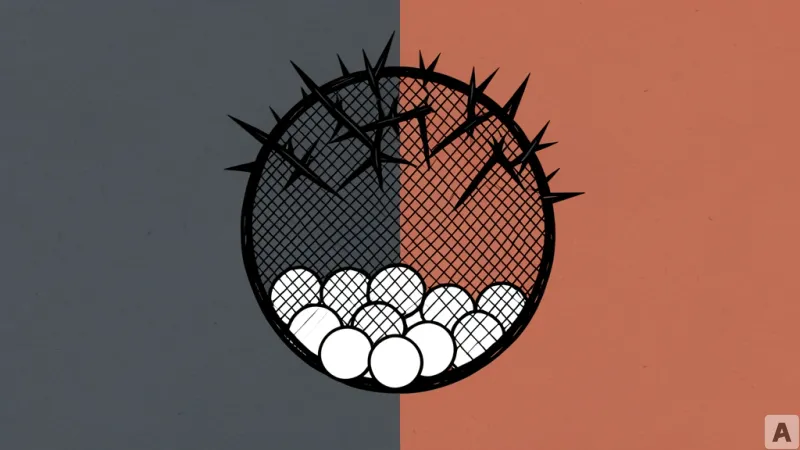

그래서 일부러 기능을 조절하며 어떤 보안 장치가 가장 잘 작동하는지 실험하고 있는 것이다. 이는 마치 아주 큰 금고를 만들기 전에 작은 상자에 자물쇠를 달아 테스트하는 것과 같다. 결국 이번 모델은 더 큰 모델을 안전하게 세상에 내놓기 위해 반드시 거쳐야 하는 징검다리 역할을 한다. 무조건적인 성능 향상보다 통제 가능한 안전함이 더 중요하다는 판단이다.

보안 전문가를 위한 특별한 통로

물론 모든 기능을 막은 것은 아니다. 컴퓨터 보안 전문가(해킹을 막는 연구를 하는 사람)들을 위해 특별한 길을 열어두었다. 컴퓨터의 약점을 찾는 연구나 가짜로 공격해 보며 약점을 찾는 시험, 그리고 공격자 입장에서 문제를 찾는 활동을 하는 전문가들은 검증 프로그램에 참여할 수 있다.

이들은 일반 사용자보다 더 넓은 권한을 가지고 모델을 사용하며 보안 성능을 함께 확인한다. 일반 사용자에게는 안전한 울타리를 쳐주고, 전문가에게는 울타리 밖을 연구할 도구를 주는 방식이다. 이는 AI가 단순히 똑똑해지는 것을 넘어 어떻게 책임감 있게 쓰일 수 있는지를 보여주는 실제 사례다.

이제 AI의 경쟁은 누가 더 똑똑한가를 넘어 누가 더 안전한가로 옮겨가고 있다.