음원 스트리밍 플랫폼의 저작권 관리자가 파형 하나를 뚫어지게 쳐다본다. AI 탐지기는 이 곡을 AI 생성물로 분류했지만, 작곡가는 사람이 직접 쓴 곡이라고 주장한다. 관리자는 현재의 탐지 도구가 음악적 스타일이라는 모호한 기준에 의존해 추측하고 있다는 사실을 깨닫는다.

ArtifactNet의 물리적 탐지 메커니즘과 수치

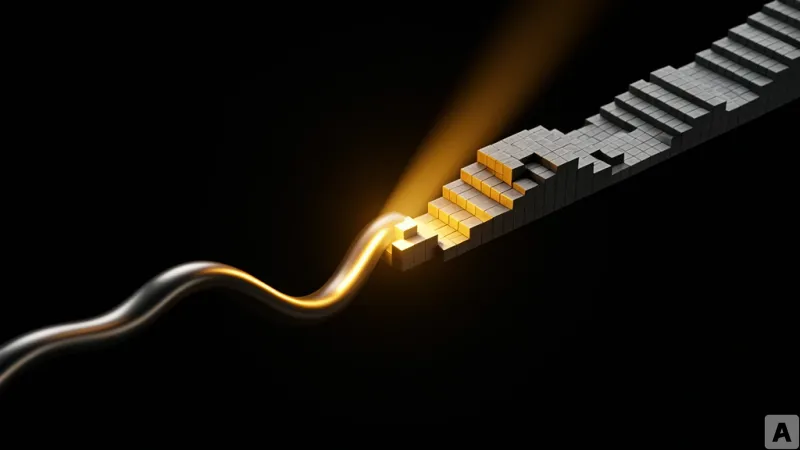

ArtifactNet은 AI 음악이 생성되는 물리적 경로를 추적하는 경량 포렌식 프레임워크다. 모든 상용 AI 음악 생성기는 RVQ(Residual Vector Quantization, 연속적인 오디오 데이터를 이산적인 코드북 벡터로 변환하는 기술)를 통과해야 한다. 이 과정에서 발생하는 양자화 갭은 되돌릴 수 없는 물리적 흔적을 남긴다. ArtifactNet은 이 갭이 만들어내는 구조화된 재구성 잔차를 포렌식 신호로 활용한다.

전체 파이프라인은 4.0M 파라미터로 구성된다. 3.6M 규모의 ArtifactUNet이 STFT(Short-Time Fourier Transform, 소리 신호를 시간과 주파수 성분으로 분해하는 기법) magnitude에 [0, 0.5]로 제한된 곱셈 마스크를 예측한다. 이 모델은 Demucs v4(음원에서 보컬과 악기를 분리해 주는 도구) 잔차를 교사로 삼아 2단계 지식 증류 학습을 거쳤다. 여기에 잔차를 조화음과 타악음으로 분해한 7채널 HPSS(Harmonic-Percussive Source Separation, 소리를 조화음과 타악음 성분으로 나누는 기술) 포렌식 피처를 결합한다. 마지막으로 0.4M 규모의 경량 CNN(Convolutional Neural Network, 이미지나 신호 패턴 인식에 특화된 신경망)이 4초 세그먼트를 처리해 곡 단위의 중앙값으로 판정한다.

성능 지표는 압도적이다. 6,183개 트랙과 22개 생성기를 투입한 ArtifactBench 테스트 결과, ArtifactNet은 F1(정밀도와 재현율의 조화 평균으로 측정하는 모델 성능 지표) 0.983을 기록했다. FPR(False Positive Rate, 실제로는 사람이 만든 음악인데 AI로 잘못 판정하는 비율)은 1.5%에 불과하다. 반면 기존 모델인 CLAM은 FPR이 69.3%에 달해 판별기로서의 기능을 상실한 수준이다. 물리적 증거인 음원 분리 잔차의 유효 대역폭을 측정하면 차이는 더 명확하다. 인간 음악의 평균 대역폭은 1,996 Hz인 반면, AI 음악은 평균 291 Hz에 집중된다. Suno v3.5는 170 Hz, Riffusion(이미지 생성 AI를 응용한 음악 생성 도구)은 219 Hz, MusicGen(메타가 공개한 텍스트 기반 음악 생성 모델)은 255 Hz로 나타났다.

분포 학습에서 물리 분석으로의 지형 변화

기존의 AI 탐지기들은 AI 음악이 어떻게 들리는지, 즉 데이터의 분포를 학습했다. 이는 생성 모델이 업데이트되어 스타일이 바뀌면 탐지 성능이 급격히 무너지는 치명적인 약점이 된다. ArtifactNet은 AI 음악이 왜 물리적으로 다르게 생성되는지에 집중한다. 아키텍처와 무관하게 모든 AI 생성기가 RVQ라는 물리적 제약을 공유한다는 점을 파고든 포석이다.

이 기술은 AI 음악 판별의 기준을 주관적 스타일에서 객관적 물리 증거로 옮긴다. 저작권 분쟁이나 플랫폼의 콘텐츠 필터링 과정에서 법적 근거로 활용될 수 있는 데이터 밀도를 확보했다. 다만 완벽한 방패는 아니다. 44.1kHz 입력이 필수적이며, 저비트레이트 MP3 파일에서는 FPR이 8%까지 상승한다. 특히 Demucs를 이용해 잔차를 지워버리는 세탁 공격을 가할 경우 TPR(True Positive Rate, 실제 AI 음악을 정확하게 AI로 판정하는 비율)이 94%로 감소한다. 최신 모델인 Udio(고품질 음악 생성 AI)의 경우 TPR은 87% 수준으로 떨어진다.

결국 AI 음악의 진위 공방은 미학적 분석의 영역에서 디지털 포렌식의 영역으로 완전히 넘어갔다.