최근 AI 코드 리뷰 도구의 신뢰성에 대한 의문이 커지고 있다. "AI 리뷰를 신뢰할 수 있을까?"라는 질문이 개발자들 사이에서 자주 오간다. 특히, AI가 생성한 코드의 품질이 인간이 작성한 코드에 비해 얼마나 신뢰할 수 있는지를 확인하기 위해 여러 기업들이 노력하고 있다. 이 과정에서 Amazon과 Shopify는 AI 코드 리뷰의 한계를 인식하고, 각각 시니어 PR(풀 리퀘스트) 승인 의무화와 AI PR 자동 머지 금지를 시행했다. 이러한 변화는 AI 리뷰가 이슈와 오류를 조기에 발견하기 위한 검증 수단으로 도입되었음을 보여준다. 그러나 AI 리뷰 자체가 비결정적이기 때문에, 그 검증 수단이 얼마나 효과적인지를 측정하는 단계가 필요하다.

AI 리뷰의 품질 측정 방법

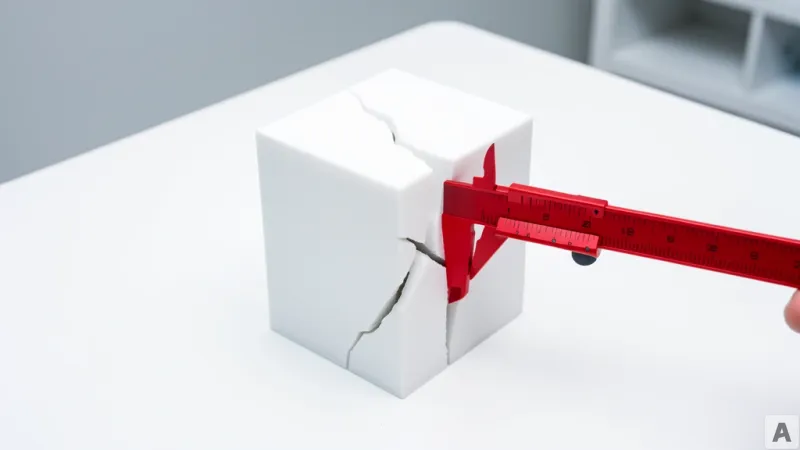

AI 리뷰의 품질을 정량적으로 측정하기 위해 개발팀은 자체 벤치마크를 구축했다. Hotfix PR을 통해 원본 PR의 시점에서 AI 리뷰가 해당 버그를 잡을 수 있었는지를 측정하는 방식이다. 이 과정에서는 PR의 차이(diff)만으로 판단 가능한 케이스를 포함하고, 외부 맥락이 필요한 경우는 배제했다. 채점은 GPT-4o mini라는 모델을 사용해 LLM(as-a-Judge)으로 진행했다. 처음 점수는 33점으로, "잘하고 있다는 느낌"은 극소수의 성공 사례에 의한 착각으로 드러났다.

AI 리뷰 도구의 실패 사례

AI 리뷰 도구의 운영 과정에서 두 가지 주요 실패 사례가 발생했다. 첫 번째는 서브에이전트 오케스트레이션 구조를 도입했을 때의 실패다. 전문 서브에이전트를 두고 메인 에이전트가 지휘하는 구조를 시도했으나, 탐지율이 감소하고 비용이 1.5배에서 3배 증가했다. 이 실패의 원인은 정보 손실, 시야 축소, 그리고 교차 영역의 책임 공백으로 분석되었다. 두 번째 실패는 벤치마크 오염으로, 자동 튜닝된 프롬프트가 "Division by Zero 체크하라"와 같은 지시의 나열로 수렴하는 문제를 겪었다. 이로 인해 외부 벤치마크를 통해 모델 선택의 근거를 세울 수 없음을 확인했다.

새로운 지표인 Adoption Rate

AI 리뷰의 효과를 측정하기 위해 Adoption Rate라는 새로운 지표가 도입되었다. 이 지표는 리뷰가 실제 코드 변경으로 이어진 경우를 "adopted"로, 변경은 없지만 답글로 상호작용한 경우를 "engaged"로, 변경도 답글도 없는 경우를 "noised"로 구분한다. 판정 방식은 리뷰 시점의 커밋 SHA와 머지 시점의 SHA를 비교하고, 코멘트 라인에서 ±3줄 내의 변경 여부로 adopted를 판별한다. Opus 4.6과 GPT-5.2 Codex 모델을 비교한 결과, Opus 4.6은 빠르고 창의적이지만 꼼꼼함이 부족한 반면, GPT-5.2 Codex는 느리지만 꼼꼼한 리뷰를 제공했다. Codex 모델을 고정한 후 주간 반영률이 최고 60%에 달하는 성과를 기록했다.

반영률을 높이기 위한 조치

반영률을 높이기 위해 세 가지 조치를 시행했다. 첫 번째는 확실하지 않은 사항에 대해 지적하기보다는 질문으로 접근하는 것이었다. 두 번째는 PR 템플릿에 Intent/Decisions 섹션을 추가하여, Intent에는 "왜 필요한가"라는 질문에 대한 답변을 삽입하고, Decisions에는 Claude Stop 훅을 통해 대화 세션의 의사결정을 자동으로 추출하는 방식이다. 마지막으로, 리뷰 반영 확인 시 AI가 스레드를 자동으로 닫는 조치를 취했다. 이러한 조치로 인해 리뷰어의 맥락 부족으로 발생하던 오탐이 약 29% 감소했다.

결과

이러한 일련의 조치를 통해 월간 반영률이 63%에 달하는 성과를 거두었다(2026-04-17 기준). 모든 액션이 데이터 기반으로 이루어져 다음 실험 판단도 근거 있게 가능해졌다. 그러나 Adoption Rate도 "채택 = 정답"을 보장하지 않기 때문에 이 지표 역시 오염될 수 있음을 경계해야 한다.