이번 주 개발자 커뮤니티에서는 가상 피팅을 위해 꽉 끼는 옷을 입고 조명을 맞추느라 5분을 허비하는 사용자들의 고충이 다시 화두에 올랐다. 사진 한 장 없이 신체 치수를 정확히 뽑아낼 수 없을까 하는 갈증이 극에 달한 시점이다.

8개 질문과 58개 파라미터의 조합

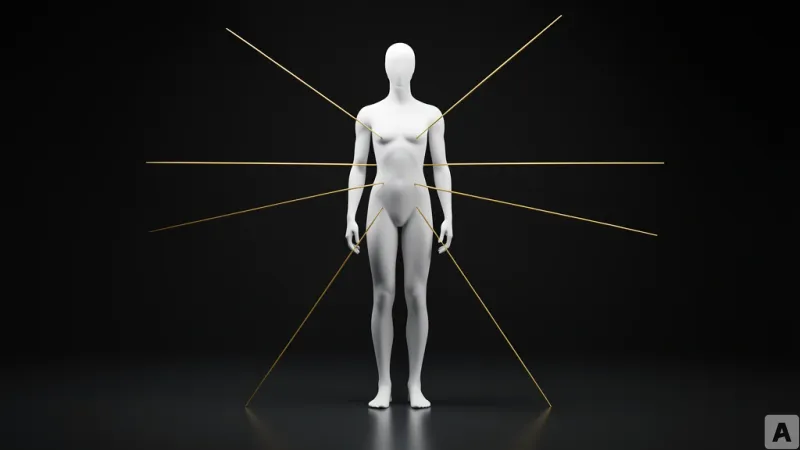

연구팀은 8개의 설문 질문을 통해 58개의 Anny(신체 형태를 정의하는 파라미터 모델) 바디 파라미터를 출력하는 소형 MLP(다층 퍼셉트론, 인공신경망의 기본 구조) 모델을 공개했다. 이 모델은 CPU에서 밀리초 단위로 작동하며 신장 오차 0.3cm, 체중 오차 0.3kg, BWH(가슴-허리-엉덩이 둘레) 오차 3~4cm를 기록했다. 8개의 질문은 원-핫 인코딩(데이터를 0과 1의 벡터로 변환하는 방식)을 통해 20개의 특징으로 변환되며, 성별에 따라 각각 별도의 네트워크를 사용한다. 모델 크기는 약 85KB로 매우 작으며, 256개 유닛의 은닉층 2개와 ReLU(활성화 함수), 드롭아웃(과적합 방지를 위해 뉴런을 무작위로 끄는 기법)이 적용되었다.

사진 기반 재구성의 한계를 넘는 회귀 분석

예전에는 HMR(사람의 사진에서 3D 메쉬를 복원하는 기술) 같은 사진 기반 재구성에 의존해 디지털 트윈을 만들었다. 하지만 이번 방식은 사진 없이 키와 몸무게, 체형, 컵 사이즈, 성별 같은 8가지 정보만으로 접근한다. 기존의 단순 선형 회귀(변수 간의 선형 관계를 분석하는 통계 기법) 방식은 동일한 키와 몸무게라도 근육질인지 복부 비만인지 구분하지 못해 BWH 오차가 최대 25cm까지 벌어졌다. 반면 이번 MLP 모델은 물리 기반 손실 함수(물리적 법칙을 학습 과정에 반영하는 방식)를 도입해 질량 계산의 불일치를 해결하고 근육량에 따른 무게 차이까지 모델링했다.

개발자가 바로 체감하는 변화는 인프라 비용의 극적인 감소와 사용자 경험의 개선이다. GPU(그래픽 처리 장치) 없이 CPU만으로 구동되므로 서버 비용 부담이 사라졌고, 사용자는 더 이상 프라이버시 노출 위험이 있는 전신사진을 찍어 업로드할 필요가 없다. 특히 역삼각형 체형처럼 허리선 변화가 민감한 경우에도 높은 정확도를 유지하며 의류 사이즈 추천의 정밀도를 높였다.

정교한 데이터셋과 물리적 제약 조건만 있다면, 거대한 모델보다 작은 MLP 하나가 더 실용적인 정답이 될 수 있음을 증명했다.