매일 아침 깃허브와 허깅페이스를 확인하는 개발자들 사이에서 이번 주 가장 뜨거운 화제는 단연 DeepSeek(중국의 AI 연구소)의 행보다. 작년 12월 V3.2 모델을 내놓은 이후 잠잠하던 이들이, 드디어 차세대 모델인 DeepSeek-V4 시리즈의 프리뷰 버전을 세상에 꺼내 놓았다. 커뮤니티에서는 벌써부터 이 모델이 기존의 거대 언어 모델들이 점유하고 있던 시장의 판도를 어떻게 흔들지, 특히 그 압도적인 가성비가 실무 환경에 어떤 변화를 가져올지 열띤 토론이 이어지고 있다.

DeepSeek-V4-Pro와 Flash의 기술적 사양

이번에 공개된 모델은 DeepSeek-V4-Pro와 DeepSeek-V4-Flash 두 가지다. 두 모델 모두 100만 토큰의 컨텍스트 윈도우를 지원하는 Mixture of Experts(여러 전문가 모델을 조합해 효율을 높이는 구조) 방식을 채택했다. Pro 모델은 총 1.6조 개의 파라미터(매개변수)를 보유하며, 이 중 490억 개가 활성 파라미터로 작동한다. Flash 모델은 총 284억 개의 파라미터 중 130억 개를 활성 파라미터로 사용한다. 라이선스는 MIT 라이선스를 따르며, 허깅페이스(AI 모델과 데이터셋을 공유하는 플랫폼)에서 각각 865GB와 160GB 크기로 내려받을 수 있다. DeepSeek 허깅페이스 저장소를 통해 모델 가중치에 접근할 수 있으며, 현재 많은 개발자가 로컬 환경에서의 구동 가능성을 타진하고 있다.

효율성 극대화를 통한 비용 절감 전략

예전에는 거대 모델을 돌리기 위해 막대한 컴퓨팅 자원과 비용을 감수해야 했지만, 이제는 상황이 완전히 달라졌다. DeepSeek가 공개한 논문에 따르면, 100만 토큰 컨텍스트 환경에서 DeepSeek-V4-Pro는 이전 모델인 V3.2 대비 단일 토큰 연산량(FLOPs)의 27%, KV 캐시(모델이 문맥을 기억하기 위해 사용하는 메모리 공간) 점유율의 10%만을 사용한다. Flash 모델은 여기서 더 나아가 연산량 10%, KV 캐시 7% 수준으로 효율을 극대화했다. 이러한 기술적 개선은 가격 정책에도 그대로 반영되었다. DeepSeek의 공식 가격표를 보면 Flash 모델은 100만 토큰당 입력 0.14달러, 출력 0.28달러에 불과하다. Pro 모델 역시 100만 토큰당 입력 1.74달러, 출력 3.48달러로 책정되어, OpenAI, Gemini, Anthropic 등 주요 기업의 최상위 모델들과 비교했을 때 압도적인 가격 경쟁력을 보여준다. DeepSeek 공식 가격 페이지에서 상세한 비용 구조를 확인할 수 있다.

성능과 로컬 구동의 가능성

개발자가 바로 체감하는 변화는 로컬 머신에서의 구동 가능성이다. 현재 많은 사용자가 OpenRouter(다양한 AI 모델을 API로 통합 제공하는 서비스)를 통해 모델을 테스트하고 있으며, Unsloth(모델 학습과 추론 속도를 최적화해 주는 도구) 팀의 양자화 버전 출시를 기다리는 분위기다. 벤치마크상으로 Pro 모델은 GPT-5.2나 Gemini-3.0-Pro와 대등한 수준의 추론 능력을 보여주지만, 최신 모델인 GPT-5.4나 Gemini-3.1-Pro와 비교하면 약 3개월에서 6개월 정도의 기술적 격차가 존재한다는 평가다. 그럼에도 불구하고 1.6조 파라미터라는 규모는 Kimi K2.6(1.1조 파라미터)이나 GLM-5.1(7540억 파라미터)을 뛰어넘는 수치로, 오픈 웨이트 모델 중에서는 가장 큰 규모를 자랑한다. 이제 개발자들은 자신의 로컬 장비에서 이 거대한 모델을 어떻게 효율적으로 스트리밍하고 구동할지, 그 최적의 조합을 찾는 데 집중하고 있다.

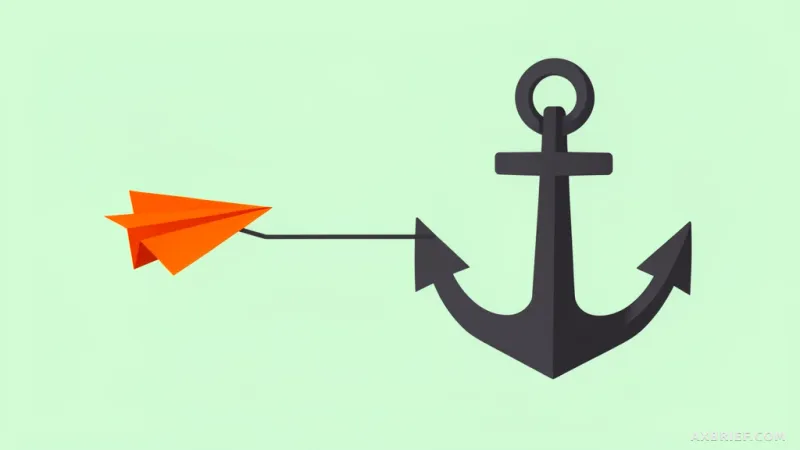

모델의 크기가 성능을 담보하던 시대에서, 이제는 동일한 성능을 얼마나 적은 비용과 연산 자원으로 구현하느냐가 진정한 실력의 척도가 되고 있다.