1인 개발자 R씨는 항공우주 제조 문서에서 노즐 목의 최대 벽 온도를 찾으려다 텍스트 검색 결과가 없어 당황했다. 정답은 텍스트가 아니라 열 등고선 도표 안에 숨어 있었다. 텍스트 기반 검색 시스템은 이미지 콘텐츠를 읽지 못해 이런 정보를 찾아내지 못한다. 이런 곤란을 겪는 개발자가 늘고 있다.

Amazon Nova Multimodal Embeddings(텍스트와 이미지를 동일한 수치 공간으로 변환하는 모델)가 Amazon Bedrock(클라우드 기반 AI 모델 관리 플랫폼)에서 제공된다. 이 모델은 텍스트, 이미지, 다중 페이지 문서를 하나의 공유 벡터 공간으로 투영한다. 임베딩 차원은 256, 384, 1024, 3072 중에서 선택할 수 있으며, 이번 평가에서는 품질과 비용의 균형을 위해 1024차원을 사용했다. 혼합 콘텐츠가 포함된 페이지를 위해 `DOCUMENT_IMAGE`라는 상세 수준 처리 모드를 지원한다. 인덱싱용 `GENERIC_INDEX`와 쿼리용 `GENERIC_RETRIEVAL`이라는 비대칭 임베딩 파라미터를 통해 검색 효율을 높였다. 데이터 저장은 Amazon S3 Vectors(S3 저장소 기반의 벡터 인덱스)를 활용한다.

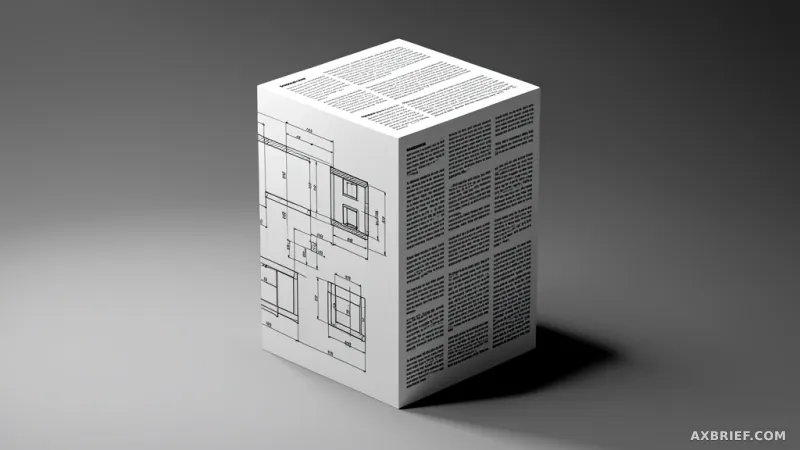

도면의 시각적 맥락을 읽는 벡터 검색

예전에는 이미지에서 텍스트를 추출하는 OCR(광학 문자 인식) 과정을 거쳐 텍스트 임베딩을 생성했다. 이 방식은 도면 내의 공간적 관계나 검사 이미지의 시각적 패턴, 차트에 인코딩된 정량적 정보를 놓치는 한계가 있다. 예를 들어 터보 펌프 베어링에 대한 검색 시, 정답이 단면도의 라벨링된 콜아웃에 있을 경우 OCR은 이를 잘못 읽거나 공간적 맥락을 삭제한다. 이제는 이미지를 텍스트로 변환하지 않고 모델이 직접 처리하여 텍스트와 동일한 좌표계의 벡터를 생성한다. 텍스트 쿼리가 OCR 결과물이 아닌, 단면도의 시각적 이해를 바탕으로 해당 도면을 직접 찾아내는 식이다.

제조 데이터셋 기반의 성능 검증

개발팀이 구축한 평가 환경은 15개의 기술 이미지와 5개의 다중 페이지 PDF로 구성된 항공우주 제조 데이터셋을 기반으로 한다. 데이터셋에는 CAD(컴퓨터 지원 설계) 도면, 용접 검사 보고서, Inconel 718 피로 S-N 곡선, 조립 절차서, 열화 테스트 보고서 등이 포함되었다. 특히 토크 사양 표가 텍스트가 아닌 도면 내부에 그려져 있거나, 로켓 엔진 노즐의 피크 온도를 시각화한 색상 코드 열 등고선 플롯 같은 데이터가 핵심이다. 공정 흐름도 내의 결정 다이아몬드와 색상 코드 게이트 같은 시각적 요소와 그에 부수된 사이클 타임 주석까지 모두 벡터화 대상이다.

개발자가 체감하는 변화는 검색 파이프라인의 단순화와 정확도 향상이다. 텍스트 전용 파이프라인은 Amazon Nova 2 Lite(경량화된 생성형 AI 모델)를 통해 OCR 텍스트를 먼저 추출한 뒤 임베딩했지만, 멀티모달 파이프라인은 이미지를 직접 임베딩했다. 두 경로 모두 Amazon S3 Vectors에 저장한 뒤 26개의 제조 쿼리를 실행해 Recall@K, MRR(평균 상호 순위), NDCG@K(정규화된 누적 이득) 지표를 측정했다. 최종 답변 생성에는 다시 Amazon Nova 2 Lite를 사용했으며, LLM(대규모 언어 모델) 판정 도구를 통해 정답과의 일치 여부를 점수화하여 생성 품질을 비교했다.

이제 AI 검색의 승부처는 텍스트 추출 능력이 아니라 시각적 맥락을 얼마나 정교하게 벡터화하느냐에 달려 있다.