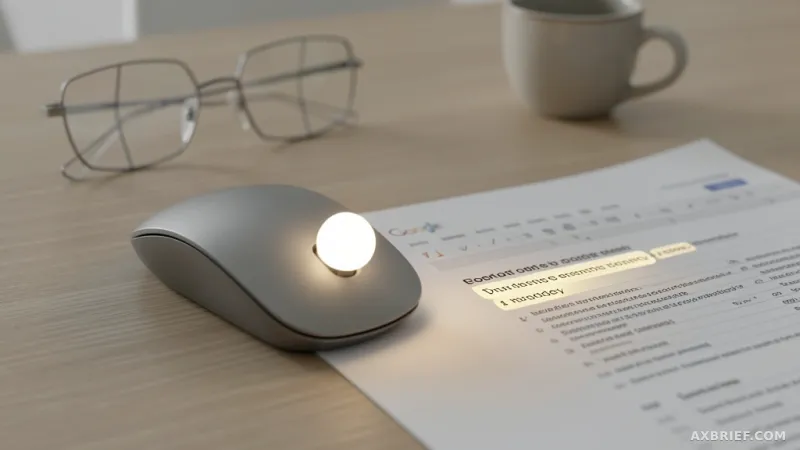

구글 딥마인드가 이번 주 제미나이(Gemini) 기반 AI 마우스 포인터를 실험 단계로 공개했다. 이 시스템은 커서 위치뿐 아니라 사용자가 가리키는 대상의 시각적·의미적 맥락을 이해한다. 두 개의 데모가 구글 AI 스튜디오(Google AI Studio)에서 오늘부터 작동한다. 하나는 이미지 편집, 다른 하나는 지도 위치 검색이며 모두 포인팅과 음성 명령으로 조작한다.

크롬과 구글북에 통합되는 매직 포인터

더 깊이 통합된 버전인 매직 포인터(Magic Pointer)가 크롬 브라우저 안에서 순차적으로 배포 중이다. 추가 통합은 이번 주 발표된 구글북(Googlebook, 제미나이 기반 노트북 라인)에 예정되어 있다. 연구팀이 해결하려는 문제는 명확하다. 사용자가 작업 중 AI 어시스턴트를 쓰려면 현재 창을 벗어나 채팅 인터페이스로 이동해 맥락을 다시 설명해야 한다는 점이다. 이 시스템은 반대 방향으로 설계되었다. AI가 사용자의 작업 흐름 안으로 들어온다.

네 가지 설계 원칙

연구팀은 네 가지 원칙을 제시했다. 첫째, 흐름 유지(Maintain the flow)다. AI 기능이 모든 앱에서 작동해야 하며 사용자를 'AI 우회로'로 빠지게 해선 안 된다. 프로토타입은 사용자가 작업 중인 모든 도구에서 포인터 수준으로 존재한다. PDF를 가리키며 요약을 요청하거나 통계표 위에 커서를 두고 원형 차트를 만들라고 말할 수 있다.

둘째, 보여주고 말하기(Show and tell)다. 현재 AI 모델은 정밀한 텍스트 프롬프트를 요구한다. 이 시스템은 커서 위치의 시각적·의미적 맥락을 자동으로 포착해 모델 입력으로 전달한다. 기술적으로는 커서 호버 상태와 주변 UI 콘텐츠를 구조화된 입력으로 처리한다. 멀티모달 모델이 이미지와 텍스트를 함께 처리하는 방식과 유사하지만, 여기서는 시각 영역이 움직이는 커서 주변에서 실시간으로 동적 크롭된다.

셋째, '이것'과 '저것'의 힘(Embrace the power of 'This' and 'That')이다. 인간은 일상 대화에서 '이거 고쳐줘', '저거 여기로 옮겨' 같은 직시어(deictic language, 가리키는 동작에 의존해 의미를 전달하는 단어)를 자연스럽게 쓴다. 이 시스템은 포인팅과 음성, 맥락을 결합해 사용자가 '이것'이 무엇을 가리키는지 풀어 설명할 필요 없이 명령을 이해한다.

넷째, 픽셀을 행동 가능한 개체로 전환(Turn pixels into actionable entities)이다. 커서 아래 시각 콘텐츠에서 추론 시간에 개체 추출을 수행한다. 낙서 메모 사진이 대화형 할 일 목록으로 바뀌고, 여행 영상의 일시 정지 프레임이 식당 예약 링크로 변환된다. 이는 원시 픽셀 영역을 타입이 지정된 행동 가능한 개체로 바꾸는 기술적 핵심이다.

실제 사용 장면

개발자가 바로 체감하는 변화는 작업 흐름의 단축이다. 예전에는 문서나 브라우저 탭에서 작업 중 궁금한 내용이 생기면 채팅 인터페이스로 전환해 맥락을 다시 입력하고 결과를 붙여넣어야 했다. 이제는 포인터로 대상을 가리키고 말하기만 하면 된다. 크롬에서 여러 제품을 선택하고 비교를 요청하거나, 거실 사진에서 소파를 놓을 위치를 가리키며 가상 배치를 지시할 수 있다.

개발자는 구글 AI 스튜디오에서 데모를 직접 실행할 수 있다. 명령어나 설정 예시는 아직 공개되지 않았으며, 연구팀은 기술 세부사항을 별도 문서로 제공할 예정이라고 밝혔다. 관심 있는 개발자는 구글 딥마인드의 공식 깃허브 저장소(https://github.com/google-deepmind)와 제미나이 문서(https://cloud.google.com/vertex-ai/generative-ai/docs/learn/models)를 참조할 수 있다.

포인터가 50년 만에 단순한 위치 추적기를 넘어 의미를 이해하는 도구로 진화하기 시작했다.