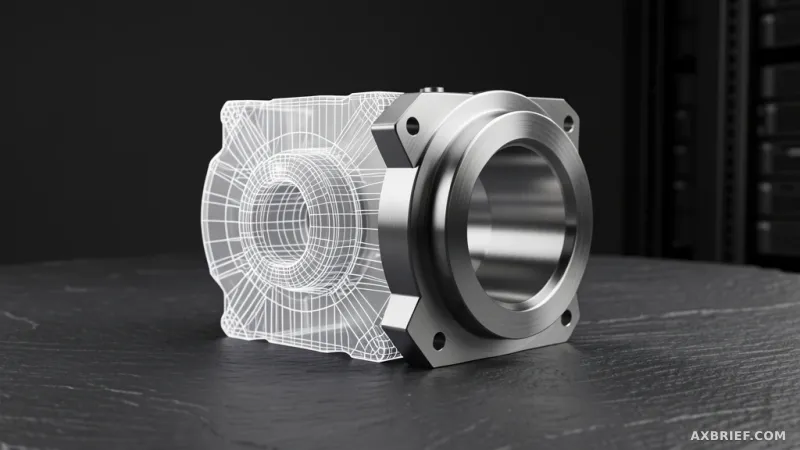

192GB. 이 수치는 AMD의 데이터센터용 GPU인 Instinct MI300X가 제공하는 HBM3(고대역폭 메모리)의 용량이다. 이 방대한 메모리 공간은 제조 현장에서 외부 클라우드 서버를 거치지 않고도 거대언어모델을 직접 구동할 수 있는 물리적 토대를 제공한다. 마치 공장 내부의 폐쇄망 안에서 모든 연산이 완결되는 보안 금고와 같다. 그런데 제조 현장의 데이터 보안 요구사항은 단순한 소프트웨어 설정을 넘어 하드웨어 아키텍처의 변화를 요구하고 있다.

제조 현장의 비효율을 제거하는 MachinaCheck

소규모 CNC(컴퓨터 수치 제어) 가공 공장의 관리자는 매주 10에서 20건의 견적 요청을 처리하기 위해 도면을 출력하고 수작업으로 치수를 확인한다. 이 과정은 도면 한 장당 30분에서 60분이 소요되며, 숙련된 관리자의 귀중한 시간을 5에서 20시간씩 잠식한다. MachinaCheck(제조 가능성 분석을 위한 다중 에이전트 AI 시스템)는 이 비효율을 해결하기 위해 개발되었다. 사용자가 STEP(표준 CAD 데이터 형식) 파일을 업로드하고 재질, 공차, 나사 규격을 입력하면 30초 이내에 제조 가능성 보고서가 생성된다. 이 시스템은 도면 해석부터 공구 가용성 확인까지 전 과정을 자동화하여 수작업의 오류를 원천 차단한다.

데이터 주권을 지키는 온프레미스 전략

예전에는 제조 기업들이 외부 API를 통해 AI를 활용하려 했으나, 이제는 기밀 유출 위험 때문에 이를 거부한다. 항공우주 부품이나 의료 기기의 도면은 수년간의 R&D가 집약된 핵심 자산이기 때문이다. MachinaCheck는 AMD Instinct MI300X의 192GB VRAM과 5.3 TB/s의 메모리 대역폭을 활용해 Qwen 2.5 7B Instruct(알리바바가 개발한 오픈소스 언어 모델)를 공장 내부 서버에서 직접 실행한다. 데이터가 외부 서버로 전송되지 않으므로 제조 기업의 지적 재산권은 공장 내부 인프라에 온전히 보존된다. 이는 단순한 보안 체크박스 수준을 넘어, 기업용 엔터프라이즈 솔루션이 갖춰야 할 근본적인 아키텍처 설계의 변화를 의미한다.

결정론적 로직과 추론의 결합

개발자가 체감하는 가장 큰 변화는 AI의 역할 범위를 명확히 구분한 점이다. MachinaCheck는 LangChain(LLM 애플리케이션 개발 프레임워크)과 FastAPI(파이썬 기반 웹 프레임워크)를 기반으로 구축되었다. 시스템은 cadquery(CAD 모델을 프로그래밍 방식으로 다루는 라이브러리)를 통해 도면의 수학적 기하학 정보를 직접 추출한다. 이 과정은 비전 모델이나 OCR(광학 문자 인식)을 거치지 않아 100%의 정확도를 보장한다. 이후 공구 가용성 확인은 LLM이 아닌 순수 파이썬 로직을 통한 데이터베이스 조회로 처리한다. LLM은 오직 제조 도메인 지식을 바탕으로 한 최종 판단과 보고서 작성에만 집중한다. 이는 환각 현상을 방지하고 시스템의 신뢰성을 극대화하는 전략적 포석이다.

bash

vLLM을 활용한 추론 환경 설정 예시

python -m vllm.entrypoints.openai.api_server --model Qwen/Qwen2.5-7B-Instruct --gpu-memory-utilization 0.5

AMD의 ROCm(AMD GPU용 오픈소스 소프트웨어 플랫폼)과 vLLM(대규모 언어 모델 서빙 엔진)을 활용한 환경 구축은 매우 직관적이다. 현재 설정에서는 192GB 중 약 96GB만을 사용하여 충분한 여유 공간을 확보했으며, 추론 지연 시간은 평균 3초 미만이다. 향후 더 높은 추론 품질이 필요할 경우 Qwen 2.5 72B 모델로 즉시 확장할 수 있는 하드웨어적 유연성도 갖췄다.

제조업의 디지털 전환은 클라우드 의존도를 낮추고 현장 중심의 고성능 컴퓨팅을 내재화하는 방향으로 재편될 것이다.