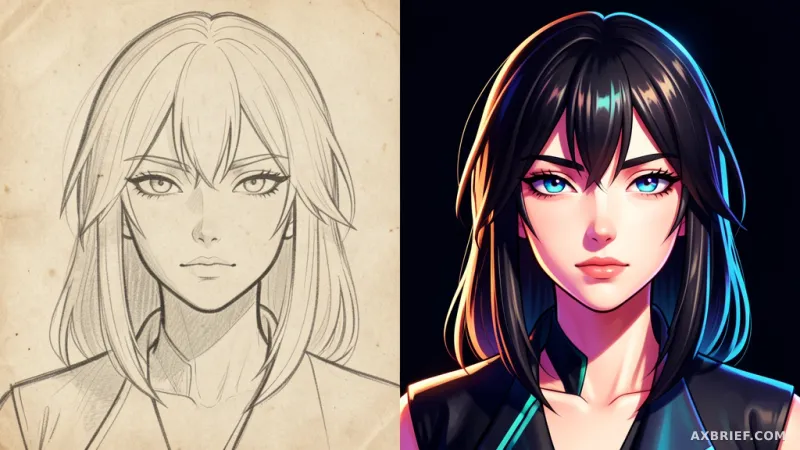

2025. 이 수치는 Anima 모델의 학습 데이터 컷오프 시점을 의미한다. 최신 유행하는 화풍을 실시간으로 반영한 화가가 붓을 든 것과 같다. 그런데 정작 주목할 점은 이 모델이 거대 모델들의 체급 경쟁을 비웃듯 20억 개의 파라미터만으로 설계되었다는 사실이다. 이번 주 Hugging Face 저장소에 공개된 Anima는 실사 이미지 경쟁에 매몰된 시장에 정교한 서브컬처 스타일이라는 다른 방향성을 제시했다.

20억 파라미터와 순수 데이터의 조합

CircleStone Labs와 Comfy Org가 협업해 개발한 Anima는 20억 개의 파라미터 규모를 가진 텍스트-이미지 변환 모델이다. 학습 데이터는 수백만 장의 애니메이션 이미지와 약 80만 장의 비애니메이션 예술 이미지로 구성되었다. 반면 최근 업계의 추세인 합성 데이터(AI가 생성한 데이터를 다시 학습시키는 방식)는 전혀 사용하지 않았다. 이는 인위적인 왜곡을 배제하고 인간 아티스트의 화풍을 직접 학습했음을 뜻한다.

이 모델은 ComfyUI(노드 기반의 이미지 생성 인터페이스) 환경에서 구동된다. 사용자는 아래의 파일들을 지정된 경로에 배치해야 한다.

anima-base-v1.0.safetensors -> ComfyUI/models/diffusion_models

qwen_3_06b_base.safetensors -> ComfyUI/models/text_encoders

qwen_image_vae.safetensors -> ComfyUI/models/vaeVAE(이미지 압축 및 복원 도구)는 Qwen-Image VAE를 채택했으며, 텍스트 인코더 역시 Qwen 모델의 기술을 기반으로 한다. 기본 버전인 Anima-Base 외에도 생성 속도와 안정성을 높인 Turbo LoRA(특정 스타일을 학습시키는 소규모 모듈)가 함께 제공된다.

샘플러 선택과 프롬프트 가중치의 변화

사용자가 체감하는 가장 큰 차이는 샘플러(이미지 노이즈를 제거하는 알고리즘)에 따른 질감 변화다. er_sde 방식은 평면적인 색감과 날카로운 선을 구현하는 반면, euler_a 방식은 선을 부드럽게 처리해 2.5D 느낌의 입체감을 만든다. dpmpp_2m_sde_gpu 방식은 창의적인 결과물을 내놓지만 프롬프트에 따라 변형 폭이 크다는 특징이 있다. 회화적 질감을 위해 beta57 스케줄러(노이즈 제거 단계를 조절하는 도구)를 사용하면 저노이즈 타임스텝이 강조된다.

프롬프트 입력 방식 또한 기존 SDXL(스테이블 디퓨전 XL, 고해상도 이미지 생성 모델)과 다르다. Danbooru(이미지 태그 기반의 데이터베이스 사이트) 스타일의 태그와 자연어를 혼합해 사용하며, 가중치 설정 시 SDXL보다 더 높은 수치를 입력해야 의도한 효과가 나타난다. 예를 들어 (chibi:2)와 같은 형식을 사용한다. 아티스트 화풍 지정 시에는 이름 앞에 @ 기호를 붙이는 규칙이 적용된다.

권장되는 긍정 프롬프트는 "masterpiece, best quality, score_7, safe, "이며, 부정 프롬프트는 "worst quality, low quality, score_1, score_2, score_3, artist name"으로 구성한다. 전체 태그 적용 예시는 다음과 같다.

"year 2025, newest, normal quality, score_5, highres, safe, 1girl, oomuro sakurako, yuru yuri, @nnn yryr, smile, brown hair, hat, solo, fur-trimmed gloves, open mouth, long hair, gift box, fang, skirt, red gloves, blunt bangs, gloves, one eye closed, shirt, brown eyes, santa costume, red hat, skin fang, twitter username, white background, holding bag, fur trim, simple background, brown skirt"

범용 모델의 무거운 체급을 버리고 특정 도메인에 최적화한 초경량 모델이 실질적인 퀄리티의 우위를 점하는 시대가 왔다.