AI가 만드는 세상은 지금까지 시청하는 영상에 머물렀다. 사용자가 프롬프트를 입력하면 그럴듯한 장면이 펼쳐지지만, 그것은 결국 정교하게 계산된 픽셀의 나열일 뿐이었다. 하지만 이제는 그 안으로 직접 걸어 들어가 물건을 옮기고 지형을 바꾸는 시대가 열리고 있다. 단순한 영상 시청을 넘어 실제 물리적 구조를 가진 3D 공간을 생성하는 기술이 등장하며 콘텐츠 제작과 가상 환경 구축의 패러다임이 근본적으로 바뀌고 있다.

3D 세계를 구축하는 네 가지 단계의 기술적 설계

HY-World 2.0은 텍스트, 단일 이미지, 다각도 이미지, 비디오 등 다양한 입력 방식을 지원하는 멀티모달(다양한 형태의 데이터를 동시에 처리하는 기술) 월드 모델 프레임워크다. 이 모델의 핵심은 3D 세계를 생성하거나 기존 세계를 재구성하는 능력에 있다. 세계 생성 과정은 매우 정교한 4단계 파이프라인으로 이루어진다. 먼저 HY-Pano 2.0이 전체적인 배경이 되는 파노라마 이미지를 생성한다. 이어 WorldNav가 사용자가 이동할 궤적과 경로를 계획하며, WorldStereo 2.0이 이를 바탕으로 세계의 공간적 범위를 확장한다. 마지막으로 WorldMirror 2.0과 3DGS(3차원 가우시안 스플래팅, 점 구름을 이용해 3D 장면을 표현하는 기술) 학습을 통해 최종적인 3D 세계를 구성하고 완성한다. 특히 WorldMirror 2.0은 단 한 번의 순전파(Forward Pass, 입력 데이터가 신경망을 통과해 출력으로 나가는 과정)만으로 깊이, 표면 법선, 카메라 파라미터, 포인트 클라우드(3차원 공간의 점들의 집합) 및 3DGS 속성을 동시에 예측하는 통합 피드포워드 모델로 설계되었다. 현재 WorldMirror 2.0의 추론 코드와 모델 가중치는 HuggingFace를 통해 오픈소스로 공개된 상태이며, 나머지 구성 요소들도 순차적으로 공개될 예정이다.

비디오 생성 AI의 한계를 넘는 실질적 3D 자산의 가치

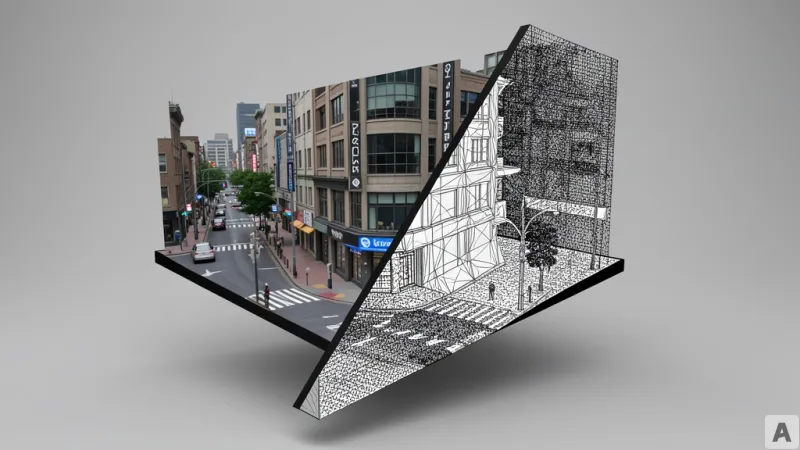

기존의 월드 모델인 Genie 3나 Cosmos, 그리고 이전 버전인 HY-World 1.5는 픽셀 단위의 비디오를 생성하는 방식이었다. 이는 사용자가 영화를 보는 것과 같아서 재생이 끝나면 사라지는 일시적인 경험에 불과했으며, 생성된 영상 속의 특정 물체를 수정하거나 다른 각도에서 자유롭게 살펴보는 것이 불가능했다. 반면 HY-World 2.0은 메쉬(Mesh, 다각형의 집합으로 3D 물체의 표면을 표현하는 방식)와 3DGS 같은 실제 3D 자산을 직접 생성한다. 이렇게 만들어진 결과물은 Blender, Unity, Unreal Engine, Isaac Sim(로봇 시뮬레이션 도구)과 같은 전문 게임 엔진이나 시뮬레이터로 즉시 가져와 편집하고 상호작용할 수 있다. 이는 단순히 영상을 기록하는 것이 아니라 실제로 플레이 가능한 게임 맵을 만드는 것과 같은 차원의 변화다. 성능 면에서도 폐쇄형 모델인 Marble과 대등한 수준의 결과물을 보여주며, 오픈소스 모델 중에서는 최첨단 성능을 기록하고 있다. 개발자들은 이제 고가의 장비로 3D 스캔을 수행하지 않고도 텍스트나 사진 몇 장만으로 정교한 3D 환경을 구축해 가상 현실 콘텐츠 제작이나 로봇의 강화 학습 환경 구축에 즉시 적용할 수 있게 되었다.

HY-World 2.0은 시각적 모방을 넘어 디지털 세계의 물리적 실체를 생성하는 3D AI 시대의 새로운 표준을 제시한다.