최근 깃허브의 Google_Gemma 저장소에 8GB짜리 소형 보드에서 스스로 판단하고 움직이는 VLA(시각-언어-행동 모델) 데모가 올라오며 개발자들의 이목을 끌고 있다. 사용자가 질문을 던지면 모델이 상황에 따라 스스로 카메라를 켜서 사진을 찍고, 그 내용을 바탕으로 답변을 내놓는 장면이 핵심이다. 기존의 단순한 이미지 캡셔닝이나 정해진 키워드에 반응하는 봇과는 완전히 다른 움직임이다.

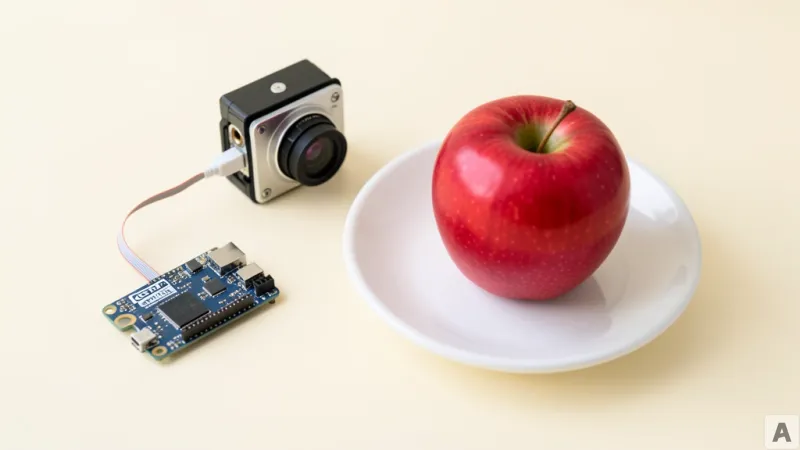

Jetson Orin Nano Super 기반 Gemma 4 구동 환경

이번 데모는 Jetson Orin Nano Super(엔비디아가 만든 소형 AI 컴퓨터) 8GB 모델에서 작동한다. 핵심 모델은 Gemma 4(Google의 최신 경량 언어 모델)이며, 이를 효율적으로 실행하기 위해 llama.cpp(LLM을 효율적으로 실행하게 돕는 라이브러리)를 네이티브로 빌드해 사용한다. 모델의 정밀도를 낮춰 용량을 줄인 Q4_K_M(양자화 버전) 설정이 권장되며, 메모리가 부족할 경우 Q3 양자화 모델로 낮춰 사용할 수 있다.

설치를 위해 먼저 다음과 같은 기본 패키지를 설치해야 한다.

sudo apt-get update

sudo apt-get install -y build-essential cmake git python3-pip python3-dev libasound2-dev8GB라는 제한된 메모리 환경에서 OOM(메모리 부족으로 프로그램이 강제 종료되는 현상)을 방지하기 위해 스왑 메모리 설정이 필수적이다.

sudo fallocate -l 8G /swapfile

sudo chmod 600 /swapfile

sudo mkswap /swapfile

sudo swapon /swapfile이후 llama.cpp를 통해 서버를 실행한다. 이때 시각 기능을 위해 mmproj(시각 투영기 파일)가 반드시 포함되어야 하며, -ngl 99 플래그를 통해 모든 모델 레이어를 GPU에 올린다.

./llama-server -m gemma-4-4b-it-q4_k_m.gguf -mproj mmproj-gemma-4.bin -ngl 99 --jinja최종적으로 Python 스크립트를 실행하면 Parakeet STT(음성을 텍스트로 변환하는 기술)와 Kokoro TTS(텍스트를 음성으로 변환하는 기술) 모델이 Hugging Face에서 자동으로 다운로드되며 시스템이 활성화된다.

python3 Gemma4_vla.py만약 복잡한 빌드 과정 없이 텍스트 전용으로 테스트하고 싶다면 Jetson AI Lab에서 제공하는 Docker(컨테이너 기반 가상화 플랫폼) 이미지를 사용할 수 있다.

bash

docker run -it --rm --runtime nvidia --network host -v ~/.cache/huggingface:/root/.cache/huggingface jetson-ai-lab/llama-cpp:latest -m gemma-4-4b-it-q4_k_m.gguf -hf

하드코딩을 넘어선 자율적 도구 호출의 의미

이번 구현의 핵심은 모델이 스스로 행동을 결정한다는 점이다. 기존의 많은 AI 데모들은 특정 키워드가 입력되면 카메라 함수를 호출하는 하드코딩된 로직을 사용했다. 하지만 Gemma 4 VLA는 --jinja 플래그를 통해 활성화된 네이티브 도구 호출 기능을 사용한다. 모델은 사용자의 질문을 분석하고, 답변을 위해 시각 정보가 필요하다고 판단되는 순간에만 take_photo라는 도구를 스스로 호출한다.

이는 단순한 챗봇이 아니라 환경과 상호작용하는 에이전트로 진화했음을 의미한다. 예를 들어 지금 내 앞에 무엇이 있느냐는 질문에 모델은 스스로 카메라를 켜고 사진을 찍어 해석한 뒤 답변한다. 사진을 묘사하는 것이 아니라 질문에 답하기 위한 수단으로 시각 정보를 활용하는 것이다. 특히 이 모든 과정이 고가의 서버가 아닌 8GB 메모리의 엣지 디바이스에서 실시간으로 이루어진다는 점이 개발자 커뮤니티에서 뜨거운 반응을 얻고 있다.

결국 하드웨어 제약이 심한 환경에서도 모델의 추론 능력과 도구 사용 능력을 결합하면 물리적 세계와 상호작용하는 지능형 기기를 충분히 구현할 수 있다는 가능성을 증명한 셈이다. 엣지 AI의 방향성이 단순한 추론에서 자율적인 행동 결정으로 옮겨가고 있다.

이제 AI는 화면 속의 텍스트를 넘어 스스로 눈을 뜨고 세상을 판단하는 물리적 실체로 빠르게 진입하고 있다.