깃허브 트렌드에 이번 주 Kimi K2.6의 가중치 파일이 올라왔다. 중국 AI 연구소 Moonshot AI가 자사 어시스턴트 Kimi의 최신 모델을 오픈소스로 풀어놓은 것이다. 개발자 커뮤니티는 1조 개 파라미터 규모의 이 모델이 실제로 동작하는지 테스트에 들어갔다.

Moonshot AI는 Kimi K2.6을 오픈소스로 공개했다. 이 모델은 Mixture-of-Experts(MoE, 입력 토큰마다 일부 전문가 모듈만 활성화하는 구조) 아키텍처를 사용한다. 전체 파라미터는 1조 개지만, 토큰당 활성화되는 파라미터는 320억 개에 불과하다. 총 384개의 전문가 중 8개가 토큰당 선택되며, 1개의 공유 전문가는 항상 활성화된다. 61개 레이어(1개 밀집 레이어 포함), 어텐션 히든 차원 7,168, MoE 히든 차원 2,048, 64개 어텐션 헤드를 갖췄다.

Kimi K2.6은 네이티브 멀티모달 모델이다. 비전 인코더 MoonViT(4억 파라미터)를 통해 이미지와 비디오 입력을 구조적으로 처리한다. 어텐션 메커니즘은 Multi-head Latent Attention(MLA), 활성화 함수는 SwiGLU, 어휘 크기는 16만 토큰, 컨텍스트 길이는 25만 6천 토큰이다. 배포는 vLLM, SGLang, KTransformers에서 권장되며, Kimi K2.5와 동일한 아키텍처라 기존 설정을 재사용할 수 있다. 필요 Transformers 버전은 4.57.1 이상 5.0.0 미만이다. 가중치는 Hugging Face에서 Modified MIT 라이선스로 배포된다.

SWE-Bench Pro에서 Kimi K2.6은 58.6점을 기록했다. GPT-5.4(xhigh)는 57.7점, Claude Opus 4.6(max effort)은 53.4점, Gemini 3.1 Pro(thinking high)는 54.2점, Kimi K2.5는 50.7점이다. SWE-Bench Verified에서는 80.2점으로 최상위 모델군에 포함된다.

Terminal-Bench 2.0(Terminus-2 에이전트 프레임워크 사용)에서 66.7점을 기록했다. GPT-5.4와 Claude Opus 4.6은 각각 65.4점, Gemini 3.1 Pro는 68.5점이다. LiveCodeBench(v6)에서는 89.6점으로 Claude Opus 4.6의 88.8점을 앞질렀다. Humanity's Last Exam(HLE-Full, 도구 사용)에서는 54.0점으로 GPT-5.4(52.1점), Claude Opus 4.6(53.0점), Gemini 3.1 Pro(51.4점)를 모두 리드했다.

Moonshot AI는 두 가지 엔지니어링 사례를 공개했다. 첫 번째 사례에서 Kimi K2.6은 맥 로컬에 Qwen3.5-0.8B 모델을 다운로드해 배포한 뒤, Zig(매우 전문화된 프로그래밍 언어)로 모델 추론을 구현하고 최적화했다. 4,000회 이상의 도구 호출, 12시간 연속 실행, 14회 반복을 거쳐 처리량을 초당 약 15토큰에서 약 193토큰으로 개선했다. 최종 속도는 LM Studio보다 약 20% 빨랐다.

두 번째 사례에서 Kimi K2.6은 8년 된 오픈소스 금융 매칭 엔진 exchange-core를 자율적으로 재설계했다. 13시간 실행 동안 12개 최적화 전략을 반복하고, 1,000회 이상의 도구 호출로 4,000줄 이상의 코드를 수정했다. CPU와 할당 플레임 그래프를 분석해 병목을 찾아내고, 코어 스레드 구조를 4ME+2RE에서 2ME+1RE로 변경했다. 중간 처리량은 185% 향상(0.43→1.24 MT/s), 성능 처리량은 133% 향상(1.23→2.86 MT/s)되었다.

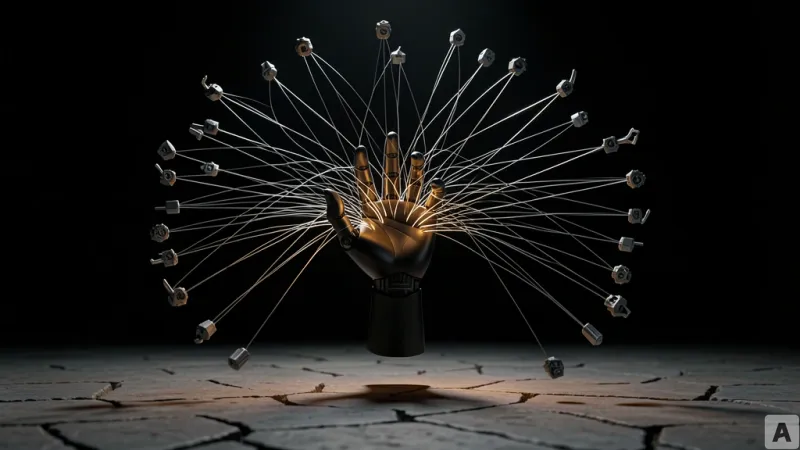

Kimi K2.6의 가장 주목할 만한 기능은 Agent Swarm(다수 전담 에이전트를 병렬 배치해 복잡 작업을 분할 처리하는 구조)이다. 최대 300개 하위 에이전트가 4,000개 협력 단계를 동시에 실행한다. 이는 K2.5의 100개 에이전트, 1,500단계에서 대폭 확장된 수치다. 스웜은 작업을 웹 검색, 심층 조사, 대규모 문서 분석, 장문 작성, 멀티포맷 콘텐츠 생성 등으로 동적으로 분할한 뒤 문서, 웹사이트, 슬라이드, 스프레드시트를 통합 출력한다.

스웜은 Skills 기능도 도입했다. PDF, 스프레드시트, 슬라이드, 워드 문서를 재사용 가능한 스킬로 변환한다. 문서의 구조와 스타일 정보를 보존해, 이후 작업에서 동일한 품질과 형식을 재현한다. 데모 사례로는 100개 하위 에이전트가 단일 이력서를 캘리포니아의 100개 관련 직무에 맞춰 100개 맞춤형 이력서로 변환한 사례, 구글 맵스에서 웹사이트가 없는 로스앤젤레스 소매점 30곳을 식별한 사례가 공개되었다.

bash

transformers 버전 확인 (>=4.57.1, <5.0.0)

pip install "transformers>=4.57.1,<5.0.0"

vLLM, SGLang, KTransformers 중 선택하여 설치

vLLM 예시

pip install vllm

Hugging Face에서 가중치 다운로드

https://huggingface.co/moonshotai/Kimi-K2.6

개발자가 바로 체감하는 변화는 SWE-Bench Pro에서 GPT-5.4를 넘긴 58.6점이다. 12시간 연속 실행으로 Zig 언어 추론 엔진을 처음부터 구현한 사례는 '장기 코딩'이 마케팅 용어가 아님을 증명한다. 300개 에이전트를 동시에 운용하는 스웜 구조는 단일 에이전트 접근의 한계를 넘어서는 설계다.

예전에는 사람이 직접 붙잡고 보던 작업이다. 이제는 모델이 13시간 동안 4,000줄 코드를 수정하고 185% 성능 향상을 스스로 찾아낸다. Moonshot AI는 이 모델을 오픈소스로 풀어놓으면서, 에이전트 워크로드의 기준점을 바꿔놓았다.