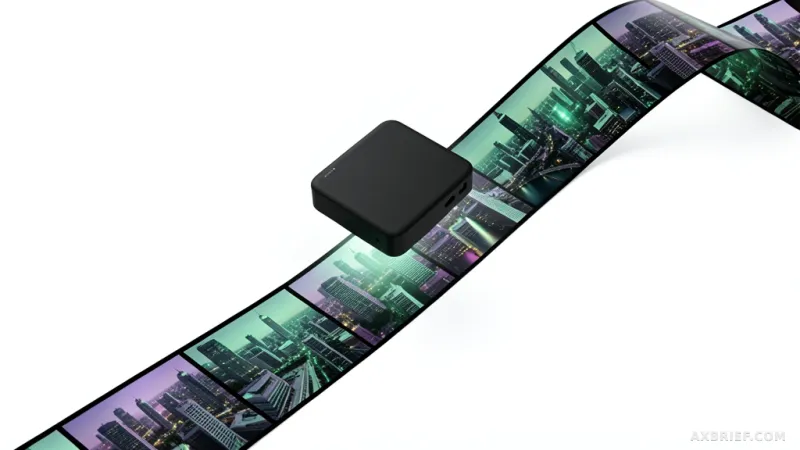

AI 컨설턴트 M씨는 최근 고해상도 월드 모델을 돌리기 위해 수십 대의 GPU 클러스터를 빌려야 하는 비용 문제로 골머리를 앓았다. 이번 주 깃허브 트렌드에 NVIDIA의 SANA-WM(가상 환경을 시뮬레이션하는 월드 모델) 저장소가 갑자기 올라오며 개발자들의 시선이 쏠렸다. 단일 GPU만으로도 분 단위의 고화질 영상을 뽑아낼 수 있다는 소식에 커뮤니티는 빠르게 달아오르고 있다. 고가의 인프라 없이도 고성능 시뮬레이션을 구현하고 싶은 개발자가 늘고 있다.

26억 파라미터로 구현한 단일 GPU 추론

NVIDIA는 26억 개의 파라미터를 가진 Diffusion Transformer(확산 트랜스포머) 기반의 SANA-WM을 공개했다. 이 모델은 720p 해상도에서 1분 길이의 영상을 생성하며, 6-DoF(6자유도 카메라 제어) 카메라 컨트롤을 지원한다. 추론 방식은 세 가지 변체로 제공된다. 고품질 오프라인 합성을 위한 양방향 생성기, 순차적 전개를 위한 청크-인과적 자기회귀 생성기, 그리고 빠른 배포를 위한 소수 단계 증류 자기회귀 생성기가 그것이다.

특히 증류된 변체는 NVFP4(NVIDIA의 4비트 부동소수점 양자화) 기술을 적용해 RTX 5090 단일 GPU에서 60초 분량의 720p 클립을 34초 만에 생성한다. 공식 코드는 NVlabs/Sana 깃허브 저장소에서 확인할 수 있다.

메모리 병목과 드리프트 현상의 해결

기존의 소프트맥스 어텐션(데이터 간의 관계를 계산하는 방식)은 시퀀스 길이가 길어질수록 메모리와 연산량이 기하급수적으로 늘어나는 문제가 있었다. SANA-Video(SANA-WM의 이전 버전)가 사용한 누적 ReLU 기반 선형 어텐션은 메모리 크기를 일정하게 유지했지만, 과거 프레임의 가중치가 동일해 시간이 흐를수록 영상이 틀어지는 드리프트 현상이 발생했다.

SANA-WM은 이를 해결하기 위해 대부분의 어텐션 블록을 프레임 단위 Gated DeltaNet(GDN, 상태를 업데이트하며 기억하는 신경망)으로 교체했다. GDN은 오래된 프레임의 가중치를 낮추는 감쇠 게이트와 예측 오차만 업데이트하는 델타 규칙을 사용해 영상 길이에 상관없이 일정한 상태 크기를 유지한다. 여기에 20개의 트랜스포머 블록 중 5개(3, 7, 11, 15, 19번 레이어)에만 소프트맥스 어텐션을 섞어 배치함으로써, GDN이 놓치기 쉬운 장거리 기억력을 보완했다.

정밀한 카메라 제어와 2단계 정제 공정

카메라 제어의 정확도를 높이기 위해 UCPE(카메라 포즈 인코딩)와 Plücker mixing(기하학적 선 표현 방식)을 결합한 듀얼 브랜치 구조를 채택했다. 1단계에서 생성된 영상의 구조적 결함은 170억 파라미터 규모의 LTX-2(비디오 생성 모델)를 기반으로 한 2단계 리파이너(정밀 보정 도구)가 해결한다. 리파이너는 랭크 384의 LoRA(저차원 적응 학습) 어댑터를 사용하며, 단 3회의 오일러 디노이징(노이즈 제거) 단계만으로 시각적 드리프트를 크게 줄였다.

데이터셋 구축 과정에서는 VIPE(카메라 포즈 주석 도구)의 백엔드를 Pi3X(일관된 깊이 추정 모델)와 MoGe-2(정밀한 거리 측정 모델)로 교체해 212,975개의 정밀한 포즈 주석 클립을 확보했다. 학습 효율을 위해 LTX2-VAE(영상 압축 도구)를 사용했는데, 이는 ST-DC-AE보다 2배, Wan2.1-VAE보다 8배 더 작아 추론 속도를 높였다. 64대의 H100 GPU를 사용한 학습 과정에서 Triton(GPU 커널 프로그래밍 언어) 커스텀 커널을 적용해 연산 효율을 1.5배에서 2배까지 끌어올렸다.

이제 거대 클러스터 없이 단일 GPU만으로도 물리 법칙이 작동하는 고해상도 가상 세계를 구축하는 시대가 열렸다.