엔비디아의 H100 칩을 확보하기 위해 수개월을 대기하던 인프라 엔지니어들의 대시보드에 새로운 선택지가 등장했다. GPU(그래픽 처리 장치)의 공급 부족과 높은 비용으로 인해 추론 속도를 높일 대안을 찾던 팀들이 특정 하드웨어 벤더의 벤치마크 결과에 주목하기 시작한 장면이다.

Cerebras의 IPO 신청과 100억 달러 규모의 계약

Cerebras Systems(AI 학습과 추론을 위한 초고속 하드웨어를 설계하는 기업)가 IPO(기업공개)를 위해 서류를 제출했다. 이 회사는 지난해 11억 달러 규모의 시리즈 G 투자를 유치했으며, 올해 2월에는 10억 달러 규모의 시리즈 H 투자를 통해 기업 가치를 230억 달러로 평가받았다. 과거 2024년에도 IPO를 추진했으나 아부다비 기반의 G42(AI 투자 및 개발사)로부터 받은 투자에 대한 연방 정부의 검토로 인해 절차가 지연되어 철회한 바 있다.

최근 이 기업은 AWS(아마존 웹 서비스)와 협력하여 아마존 데이터 센터에 Cerebras 칩을 도입하기로 합의했다. 특히 OpenAI와 체결한 계약 규모는 100억 달러가 넘는 것으로 알려졌다. 재무 성과를 살펴보면 2025년 매출은 5억 1천만 달러를 기록했다. 순이익은 2억 3,780만 달러로 보고되었으나, 일회성 항목을 제외한 non-GAAP(일반적으로 인정된 회계원칙을 따르지 않은 지표) 기준으로는 7,570만 달러의 순손실이 관찰된다. 이번 IPO의 구체적인 자금 조달 규모는 공개되지 않았으며, 상장 시점은 5월 중순으로 계획되어 있다.

범용 GPU 체제에서 전용 추론 하드웨어로의 전환

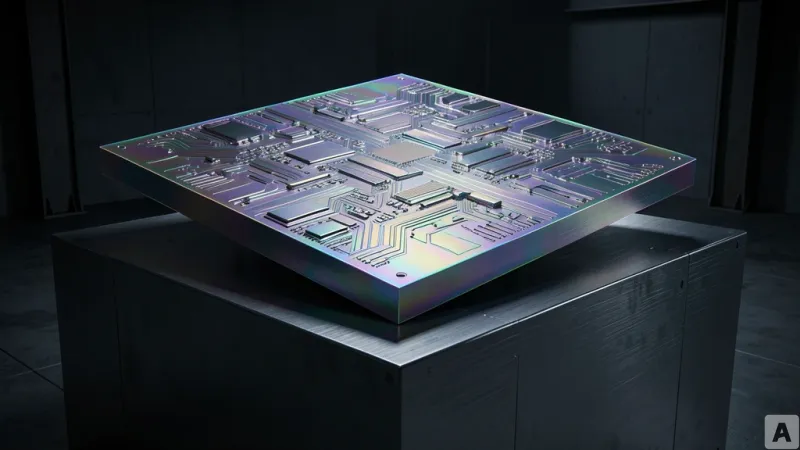

이번 움직임에서 주목할 점은 추론(학습된 모델이 입력값에 대해 결과값을 출력하는 과정) 시장의 주도권 변화다. 그동안 AI 인프라는 엔비디아가 구축한 범용 GPU 생태계가 독점해 왔다. 하지만 모델의 크기가 커질수록 추론 단계에서 발생하는 지연 시간과 전력 소모는 서비스 운영의 핵심 병목 구간이 된다. Cerebras는 범용성이 아닌 AI 연산에만 최적화된 하드웨어 구조를 통해 이 문제를 해결하려 한다.

OpenAI가 100억 달러라는 거액의 계약을 체결했다는 사실은 시사하는 바가 크다. 이는 가장 거대한 모델을 운영하는 기업조차 엔비디아의 GPU만으로는 추론 효율성을 극대화하기 어렵다는 판단을 내렸음을 의미한다. 특정 작업에 특화된 전용 칩셋이 범용 칩셋보다 압도적인 속도를 낼 수 있다면, 기업들은 인프라를 GPU 단일 체제에서 하이브리드 체제로 전환할 가능성이 높다. 이는 단순히 칩을 바꾸는 문제가 아니라, 하드웨어 가속기에 맞게 추론 엔진의 코드를 최적화하는 새로운 엔지니어링 단계가 필요함을 뜻한다.

결국 하드웨어의 성능 차이가 소프트웨어 스택의 변화를 강제하고, 이것이 다시 서비스의 응답 속도라는 사용자 경험으로 직결되는 구조다. 엔비디아가 CUDA(엔비디아 GPU 전용 소프트웨어 플랫폼)라는 강력한 소프트웨어 생태계로 시장을 묶어두었지만, 추론 효율성이라는 실무적 가치가 임계점을 넘어서면 하드웨어 교체 수요는 빠르게 확산될 것으로 분석된다.

AI 인프라의 표준이 범용 GPU에서 특정 작업에 최적화된 전용 칩셋의 조합으로 재편되는 신호탄이다.