매일 아침 같은 실수를 반복하는 AI 에이전트를 본 적이 있는가. 웹을 탐색하거나 깃허브 이슈를 해결할 때마다 에이전트는 매번 새로운 작업처럼 행동한다. 이전에 수백 번 실패한 유형의 문제라도 전혀 학습하지 않으며, 작업이 끝나는 순간 모든 교훈이 사라진다.

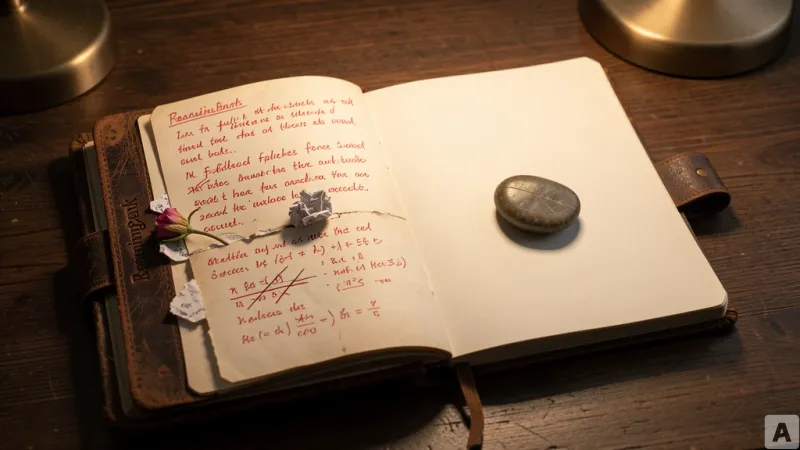

구글 클라우드 AI 연구팀이 일리노이대학교 어배너-샴페인, 예일대학교와 함께 ReasoningBank라는 메모리 프레임워크를 발표했다. 이 시스템은 에이전트가 무엇을 했는지만 기록하지 않고, 왜 성공했고 왜 실패했는지 그 이유를 재사용 가능한 일반화된 추론 전략으로 추출한다. 연구 논문은 arXiv에서 확인할 수 있다.

기존 메모리는 성공만 기억하고 실패는 버렸다

기존 AI 에이전트 메모리는 크게 두 가지 방식으로 나뉜다. Synapse라는 시스템에서 쓰는 궤적 메모리는 모든 클릭, 스크롤, 입력한 질의를 원시 로그로 저장한다. Agent Workflow Memory는 성공한 실행에서만 재사용 가능한 절차를 뽑아낸다. 두 방식 모두 치명적인 약점이 있다. 원시 궤적은 잡음이 많고 길어서 새 작업에 직접 쓰기 어렵고, AWM은 성공한 시도만 분석하기 때문에 실패에 숨겨진 풍부한 학습 신호를 완전히 버린다.

ReasoningBank는 작업마다 세 단계로 메모리를 갱신한다

ReasoningBank는 닫힌 루프 메모리 시스템으로, 모든 완료된 작업마다 세 단계가 실행된다. 첫째, 메모리 검색 단계에서는 에이전트가 새 작업을 시작하기 전에 임베딩 기반 유사도 검색으로 가장 관련성 높은 메모리 항목 하나를 찾는다. 기본값은 k=1이며, 실험 결과 메모리를 많이 가져올수록 성능이 떨어졌다. k=1일 때 성공률 49.7%에서 k=4일 때 44.4%로 하락했다.

둘째, 메모리 추출 단계에서는 작업이 끝나면 Memory Extractor가 에이전트와 같은 백본 언어모델로 구동된다. 이 추출기는 궤적을 분석해 구조화된 메모리 항목으로 만든다. 각 항목은 제목, 설명, 내용의 세 가지 구성요소를 가진다. 핵심은 성공과 실패 궤적을 다르게 처리한다는 점이다. 성공은 검증된 전략을 제공하고, 실패는 반대 사례와 예방 교훈을 제공한다.

셋째, 메모리 통합 단계에서는 새 메모리 항목이 JSON 형식으로 저장소에 추가된다. 미리 계산된 임베딩을 함께 저장해 빠른 코사인 유사도 검색이 가능하며, 이렇게 루프가 완성된다.

실패 판단은 언어모델이 맡고, 정확도 70%만 돼도 충분하다

궤적이 성공인지 실패인지 판단하기 위해 연구팀은 LLM-as-a-Judge를 사용한다. 사용자 질의, 궤적, 최종 페이지 상태를 입력으로 받아 '성공' 또는 '실패' 이진 판정을 내린다. 이 판사가 완벽할 필요는 없으며, 실험 결과 판사 정확도가 70% 수준으로 떨어져도 ReasoningBank는 견고하게 작동했다.

메모리 인식 테스트타임 스케일링: 여러 시도를 대조해 더 나은 메모리를 만든다

연구팀은 추가로 MaTTS를 도입했다. 이 기법은 수학 추론과 코딩 작업에서 이미 효과가 입증된 테스트타임 컴퓨트 스케일링과 연결된다. 핵심 아이디어는 간단하다. 같은 작업에 대해 여러 궤적을 생성하고, 가장 좋은 답만 고르고 나머지를 버리는 대신 모든 궤적을 대조 신호로 활용한다.

MaTTS는 두 가지 방식으로 작동한다. 병렬 스케일링은 같은 질의에 대해 k개의 독립적 궤적을 생성한 뒤 자기 대조로 더 높은 품질의 메모리를 추출한다. 순차 스케일링은 자기 개선으로 단일 궤적을 반복 정제하며 중간 교정과 통찰을 메모리 신호로 포착한다. WebArena-Shopping에서 k=5일 때 병렬 스케일링이 순차 스케일링을 약간 앞질렀다. 순차 방식은 모델이 결정적 성공이나 실패에 도달하면 빠르게 포화되지만, 병렬 방식은 다양한 궤적을 계속 제공해 대조 학습이 가능하기 때문이다.

세 가지 벤치마크에서 일관된 성능 향상

ReasoningBank는 WebArena, Mind2Web, SWE-Bench-Verified에서 테스트됐다. 모든 데이터셋과 모든 백본 모델에서 기준선을 일관되게 능가했다.

WebArena에서 Gemini-2.5-Flash를 사용했을 때 ReasoningBank는 메모리 없는 기준선 대비 성공률을 8.3%포인트 높였다. 평균 상호작용 단계는 메모리 없을 때보다 최대 1.4회, 다른 메모리 기준선보다 최대 1.6회 줄었다. 효율성 향상은 성공한 궤적에서 가장 두드러졌으며, 쇼핑 하위 집합에서 성공한 작업의 단계를 2.1회 줄여 26.9% 상대적 감소를 기록했다.

Mind2Web에서는 교차 도메인 설정에서 가장 큰 개선을 보였다. 이 설정은 가장 높은 수준의 전략 전이가 필요하며, 경쟁 방법인 AWM은 오히려 메모리 없는 기준선보다 성능이 떨어졌다. SWE-Bench-Verified에서는 백본 모델에 따라 결과가 의미 있게 달라졌다.

개발자가 바로 체감하는 변화는 이렇다. AI 에이전트가 같은 실수를 반복하지 않으며, 실패에서 배운 교훈을 다음 작업에 적용한다. 더 적은 단계로 더 높은 성공률을 달성한다.

AI 에이전트는 이제 기억할 뿐만 아니라, 실패에서 배우는 법을 알게 됐다.