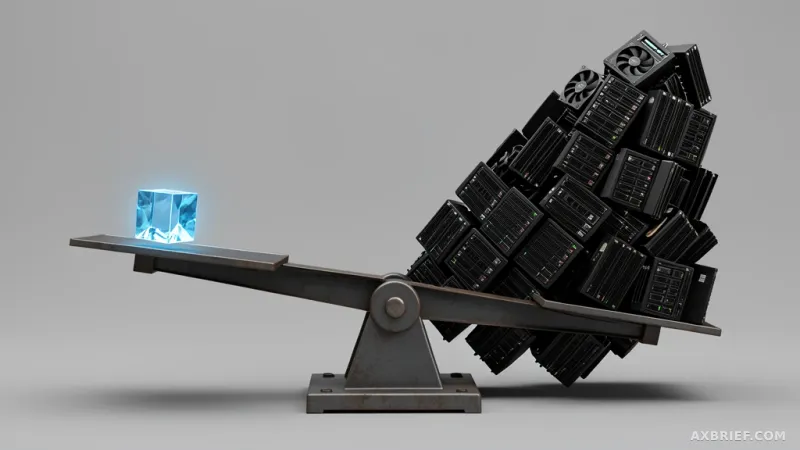

매일 아침 개발자들은 새로운 AI 모델이 등장했다는 소식을 접하며 성능을 확인하기 위해 벤치마크 점수를 살펴본다. 하지만 최근 연구 결과에 따르면, 이 점수를 뽑아내는 과정 자체가 모델을 만드는 과정만큼이나 비싼 비용을 요구하고 있다. 마치 자동차의 연비를 측정하기 위해 매번 새 차를 수천 대씩 폐차해야 하는 상황과 비슷하다. 단순히 모델의 지능을 확인하려는 시도가 이제는 기업의 예산을 휘청이게 만드는 새로운 병목 현상이 된 것이다.

평가 비용의 급증과 HAL의 사례

최근 공개된 홀리스틱 에이전트 리더보드(HAL, AI 에이전트의 실질적 수행 능력을 측정하는 통합 평가 도구)의 보고서는 이 문제의 심각성을 수치로 증명한다. 연구팀은 9개 모델과 9개 벤치마크를 대상으로 2만 1,730회의 에이전트 실행을 진행했는데, 여기에만 약 4만 달러(한화 약 5,500만 원)가 소요되었다. 특히 GAIA(AI 에이전트의 일반적인 문제 해결 능력을 측정하는 벤치마크)를 최신 모델로 한 번 실행하는 데만 캐싱 비용을 제외하고 2,829달러가 필요하다. 또한 과학적 머신러닝 분야의 벤치마크인 The Well(과학적 데이터셋 기반의 평가 프레임워크)은 새로운 아키텍처 하나를 평가하는 데 H100 GPU(고성능 AI 연산용 그래픽 카드) 960시간이 소요되며, 전체 기준을 검증하려면 3,840시간이 필요하다. 이는 평가가 더 이상 부수적인 작업이 아니라, 모델 개발의 핵심 비용 항목으로 자리 잡았음을 의미한다.

정적 벤치마크와 에이전트 평가의 차이

예전에는 모델의 성능을 측정하는 방식이 훨씬 단순했다. 2022년 스탠퍼드 대학의 CRFM(AI 모델의 기초를 연구하는 센터)이 발표한 HELM(언어 모델의 종합 평가 프레임워크) 초기 데이터만 봐도, 당시에는 정적인 문제 풀이 위주였다. 당시 연구자들은 100배에서 200배 정도의 컴퓨팅 자원을 줄여도 모델의 순위가 거의 변하지 않는다는 점을 발견했다. 이를 활용한 플래시-HELM(저비용으로 먼저 평가하고 상위 후보만 정밀 평가하는 방식)이나 tinyBenchmarks(데이터셋을 100개 핵심 항목으로 압축한 평가 도구) 같은 기술들은 데이터셋을 90% 이상 줄여도 충분히 정확한 결과를 얻을 수 있었다. 하지만 이제는 상황이 다르다. 정적인 질문에 답하는 것이 아니라, AI가 스스로 도구를 사용하고 웹을 탐색하며 여러 단계를 거치는 에이전트 평가로 넘어오면서 기존의 압축 기술은 힘을 잃었다. 에이전트 평가는 모델 자체뿐만 아니라 스캐폴드(에이전트가 작업을 수행하도록 돕는 보조 코드)와 토큰 예산이 복합적으로 얽혀 있어, 작은 설정 차이만으로도 비용이 10배 이상 널뛰기 때문이다.

결과의 불확실성과 비용 효율성 문제

개발자가 바로 체감하는 가장 큰 문제는 비용을 많이 쓴다고 해서 반드시 더 나은 결과를 얻는 것은 아니라는 점이다. 온라인 마인드투웹(Online Mind2Web, 웹 브라우징 에이전트 평가 데이터셋) 사례를 보면, 1,577달러를 쓴 모델과 171달러를 쓴 모델의 정확도 차이는 고작 2%포인트에 불과했다. CLEAR(에이전트 성능과 비용 효율성을 분석하는 연구)에 따르면, 최적의 정확도를 내는 설정이 비용 효율적인 대안보다 4배에서 10배 이상 비싼 경우가 허다하다. Ndzomga의 중간 난이도 필터링(통과율 30~70%인 작업만 선별하는 방식)이 비용을 2~3배 줄여주긴 하지만, 이는 정적 벤치마크에서 가능했던 100배 이상의 절감 효과에는 한참 못 미친다. 결국 에이전트 평가는 한 번의 질문이 수많은 단계의 실행으로 이어지는 긴 궤적을 가지고 있어, 그 자체로 비용을 줄이기 어려운 거대한 덩어리가 되어버렸다.

AI 평가의 비용 구조가 모델의 학습 비용을 추월하는 지점에 도달하면서, 이제는 성능 측정 방식 자체가 모델 설계만큼이나 중요한 기술적 경쟁력이 되었다.